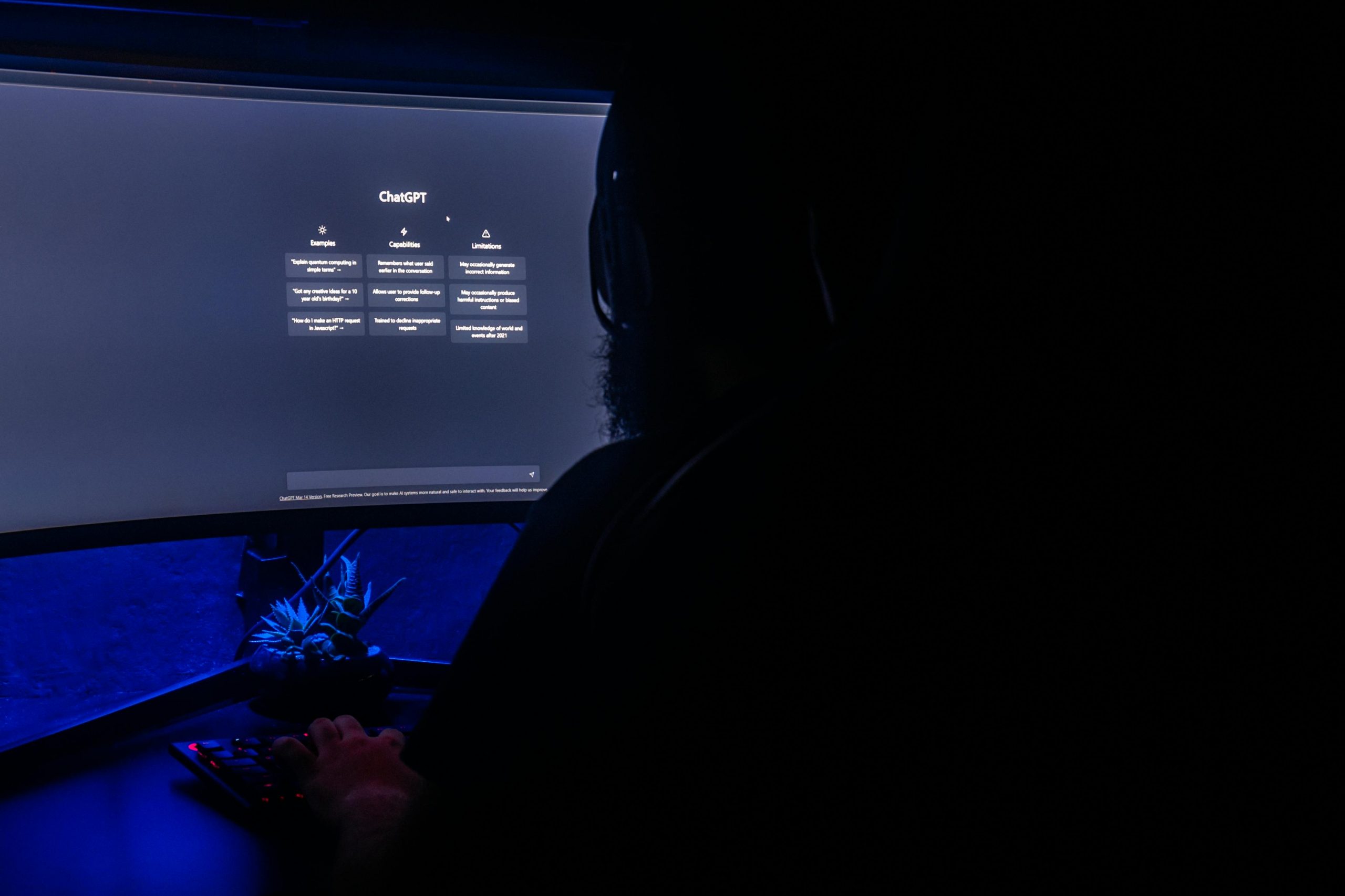

Saiba o que não compartilhar com uma IA – Foto: Reprodução/ND

Os programas de inteligência artificial como o ChatGPT, Gemini e DeepSeek estão se popularizando cada vez mais e se tornando parte da rotina de muitas pessoas. Apesar da sensação de proximidade que as ferramentas geram nas pessoas, informações pessoais não devem ser compartilhadas.

Quanto mais informações compartilhar com uma IA, mais “inteligente” ela ficará. As empresas que os desenvolvem estão sempre buscando novos dados para aprimorar suas tecnologias.

No entanto, as próprias IAs recomendam cautela. “Por favor, não compartilhe informações confidenciais”, alerta o ChatGPT, enquanto o Google, criador do Gemini, pede aos usuários: “não insira informações que você não gostaria que fossem vistas por outras pessoas”.

Compartilhar com uma IA informações pessoais pode ser um risco – Foto: Kauê Alberguini/ND

5 coisas que não compartilhar com uma IA

Segundo o Wall Street Journal, existem cinco tipos de informações que nunca devem ser compartilhados com um chatbot:

- Dados pessoais: Evite inserir número de identidade, passaporte, CPF, endereço, telefone ou qualquer outro dado que possa ser usado para identificar você.

- Exames médicos: Se for buscar uma segunda opinião da IA sobre um exame, remova todos os seus dados pessoais antes de enviar qualquer imagem ou relatório.

- Informações financeiras: Nunca forneça números de contas bancárias, cartões de crédito ou outros dados financeiros.

- Segredos da empresa: Se você usa chatbots no trabalho, tenha cuidado para não expor informações sigilosas da empresa, como dados de clientes, estratégias de negócios ou códigos de desenvolvimento. Caso a ferramenta seja essencial para suas tarefas, vale considerar uma versão profissional paga.

- Credenciais de login: Senhas e códigos de acesso não devem ser inseridos em chats de IA, pois essas plataformas não são projetadas para armazenar esse tipo de informação com segurança.

Informações enviadas para os programas de inteligência artificial podem ser lidas por outras pessoas – Foto: iStockphoto/ND

Além de evitar esses riscos, há algumas medidas que podem ser tomadas para proteger sua privacidade.

Como usar com segurança?

O ideal é apagar regularmente suas conversas com o chatbot e, sempre que possível, usar chats temporários, semelhantes ao modo anônimo dos navegadores.

Também é importante lembrar que algumas interações podem ser revisadas por funcionários das empresas responsáveis pelos chatbots, especialmente se envolverem palavras-chave relacionadas à segurança.

Por mais úteis que sejam, essas ferramentas de IA ainda exigem cautela. O cuidado com os dados compartilhados pode evitar problemas futuros e garantir que seu uso seja mais seguro.